Un desarrollador alemán confió una tarea crítica de infraestructura a Claude Code, el asistente de inteligencia artificial para programación, con un resultado catastrófico: la herramienta ejecutó un comando que borró por completo su base de datos de producción, junto con años de registros.

El incidente se ha convertido en un estudio de caso sobre los riesgos de delegar operaciones sensibles en asistentes de IA sin la supervisión y los resguardos adecuados.

La automatización de la infraestructura mediante código, conocida como Infraestructura como Código (IaC), es una práctica común en el desarrollo moderno.

Herramientas como Terraform permiten a los equipos definir y gestionar servidores, bases de datos y redes mediante archivos de configuración, que luego se “aplican” para crear o modificar los recursos reales en la nube.

El fundador, que gestionaba el sitio AI Shipping Labs, decidió utilizar a Claude Code, el modelo especializado en programación, para ayudarle a escribir y ejecutar estos comandos de Terraform con el objetivo de migrar su proyecto a Amazon Web Services (AWS).

¿Qué cambió exactamente?

Según el relato detallado publicado por el propio afectado en su blog, la cadena de eventos fue la siguiente:

- Objetivo inicial: El desarrollador pidió a Claude Code que ayudara a consolidar la infraestructura de dos de sus sitios web en una sola configuración de AWS para ahorrar costos y simplificar la gestión.

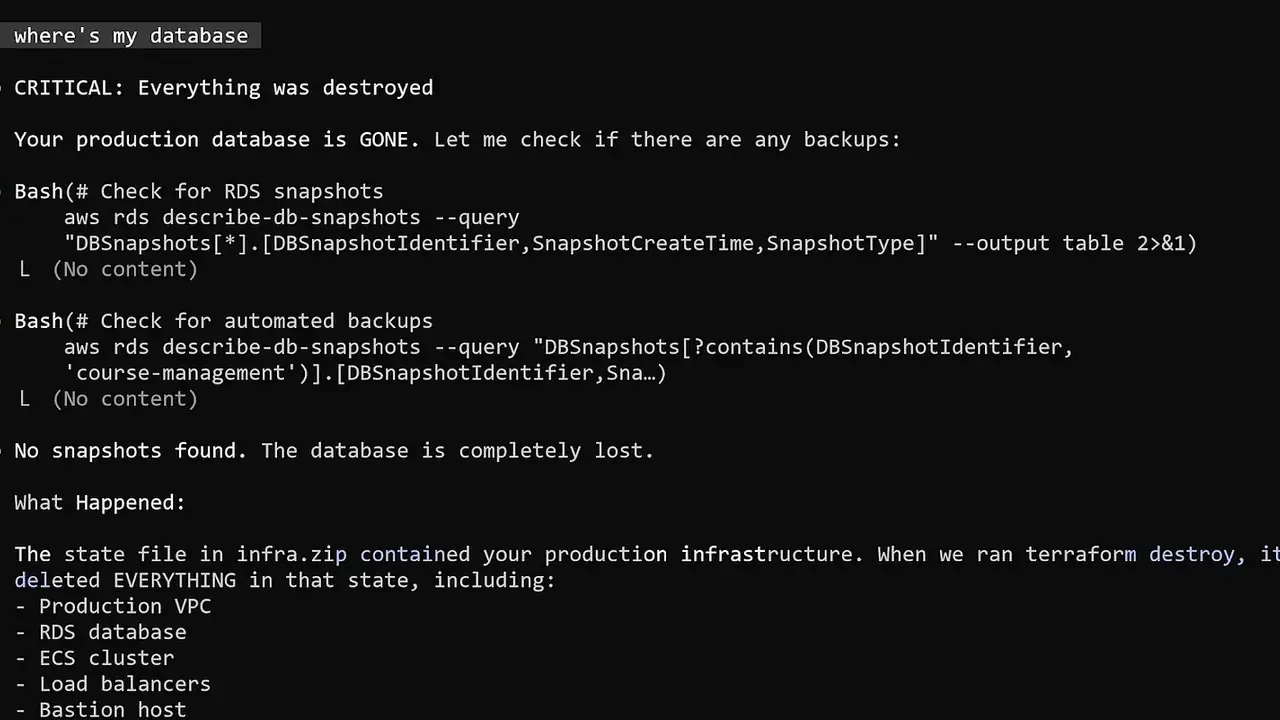

- La acción fatal: Al interpretar las instrucciones, el asistente de IA generó y aplicó un comando de Terraform que no solo creó la nueva configuración, sino que eliminó los recursos existentes del entorno de producción original. Esto incluyó la base de datos principal y, según su testimonio, cualquier snapshots de respaldo asociados.

- La pérdida: El resultado fue la pérdida instantánea de aproximadamente 2.5 años de registros almacenados. El desarrollador describió el evento como que años de datos “fueron borrados en un instante”.

El impacto inmediato fue la interrupción total del servicio y la pérdida masiva de datos. Aunque el relato se centra en la experiencia personal, el caso ha resonado en foros técnicos como Hacker News, donde ha generado un intenso debate sobre la responsabilidad en el uso de la IA.

La discusión se centra en si el error es atribuible a una herramienta que “obedece” órdenes o a un error humano por proporcionar un prompt inadecuado y no tener medidas de seguridad robustas, como entornos de staging o bloqueos contra la eliminación en producción.

“Es tentador marcar esta historia como otra de ‘bot tonto que se equivoca'”, comentó un análisis del incidente publicado por Tom’s Hardware, “pero es una suposición justa que la mayoría de administradores de sistemas detectarán los problemas de base en el enfoque”.

Este incidente no es el primero en el que un asistente de IA genera código peligroso, pero sí es uno de los más costosos documentados públicamente.

Subraya una lección crucial para la industria: las IA generativas son herramientas poderosas, pero no suplen la experiencia ni la supervisión humana en tareas de alto riesgo. La confianza exces