Un nuevo análisis de la firma de investigación Gartner ha puesto el foco en un factor de riesgo inesperado y humano para la seguridad en entornos corporativos: la fatiga de los empleados.

Según sus hallazgos, presentados en un evento en Sídney, los usuarios cansados, especialmente en horarios críticos como las tardes de los viernes, pueden volverse negligentes al verificar los resultados generados por Microsoft 365 Copilot, amplificando así vulnerabilidades existentes.

La advertencia principal señala que la sobreexposición de datos en plataformas como SharePoint se ve potenciada por el uso descuidado de estas herramientas de inteligencia artificial.

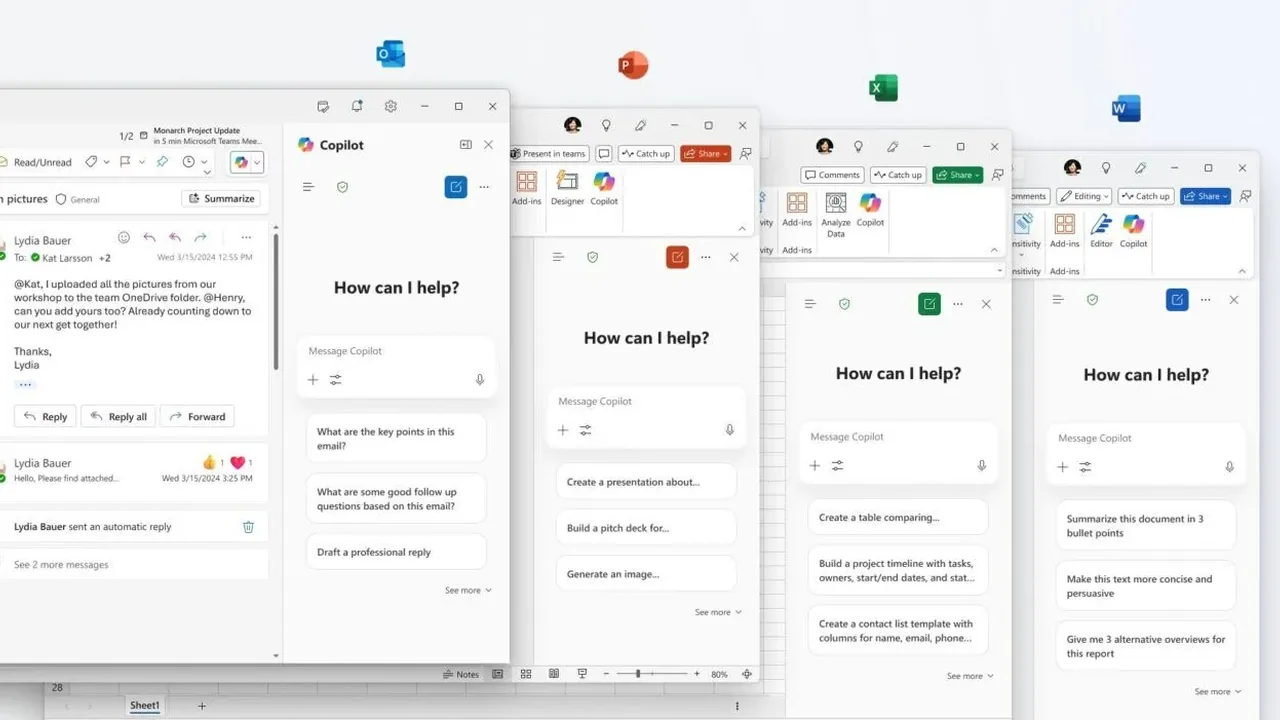

Microsoft 365 Copilot se ha integrado rápidamente como un copiloto de IA para millones de usuarios empresariales, ayudando a redactar correos, resumir reuniones y analizar datos.

Su promesa es aumentar la productividad, pero su despliegue masivo ha ido por delante de la evaluación exhaustiva de sus implicaciones en la gobernanza y la seguridad de la información corporativa.

La consultora Gartner, reconocida por sus análisis del sector tecnológico, ha decidido examinar estos riesgos en un momento en que las empresas dependen cada vez más de asistentes de IA integrados en su flujo de trabajo diario.

¿Qué pasó exactamente?

La presentación, a cargo del Vicepresidente de Investigación de Gartner, Dennis Xu, destacó que el riesgo técnico se combina con un comportamiento humano predecible.

Los hallazgos clave incluyen:

El riesgo de la fatiga humana

Según el análisis de Gartner, usuarios que están física o mentalmente agotados son propensos a aceptar y propagar resultados generados por la IA sin realizar las comprobaciones básicas.

Este fenómeno se acentuaría en momentos de baja energía, como las tardes de los viernes, planteando la necesidad de considerar restricciones de uso.

Amplificación de la sobreexposición

El riesgo principal identificado es la tendencia existente a compartir en exceso datos en repositorios como SharePoint.

Copilot, al tener acceso a estos datos, puede generar respuestas que inadvertidamente revelen información sensible a usuarios que no deberían tener acceso a ella, especialmente si el empleado no revisa el contexto de lo generado.

Un conjunto más amplio de vulnerabilidades

Aunque el núcleo del mensaje se centra en el factor humano y la sobreexposición, reportes relacionados señalan que Gartner habría enumerado un total de cinco riesgos de seguridad asociados a Copilot, incluyendo amenazas como el prompt injection y la falta de supervisión adecuada.

La advertencia de Gartner trasciende la mera recomendación técnica. Sugiere que las políticas de seguridad tradicionales, centradas en firewalls y permisos de acceso, son insuficientes para la era de la IA generativa.

Ahora, los departamentos de TI y los responsables de seguridad (CISO) deben incorporar la psicología del usuario y los ritmos laborales en sus modelos de riesgo.

“El análisis presentado por Dennis Xu subraya que la tecnología más avanzada puede verse neutralizada por el eslabón más antiguo y débil de la cadena: el factor humano en estados de baja vigilancia”, se desprende de los informes sobre el summit.

Esto podría forzar a las organizaciones a replantear no solo la configuración de sus herramientas de IA, sino también sus políticas de horarios de uso, capacitación específica sobre fatiga digital y la implementación de auditorías automatizadas adicionales para las tareas asistidas por Copilot en horarios sensibles.