La startup de inteligencia artificial Anthropic ha presentado una declaración formal ante un tribunal federal de apelaciones de Estados Unidos negando que tenga la capacidad técnica para sabotear o desactivar su modelo de lenguaje Claude una vez que este sea desplegado y utilizado por el ejército en operaciones de guerra.

Esta declaración jurídica es una respuesta directa a preocupaciones gubernamentales sobre el control que los creadores de IA podrían ejercer sobre herramientas críticas en escenarios de conflicto.

Anthropic, la empresa detrás del modelo de IA conversacional Claude, se encuentra inmersa en un caso legal contra el Departamento de Guerra de EE.UU. El litigio, que se sigue ante el Tribunal de Apelaciones del Circuito de D.C., gira en torno a las regulaciones y adquisiciones de tecnología de IA por parte del gobierno.

Según reportan medios especializados, la administración Trump había expresado preocupaciones sobre la posibilidad de que la empresa pudiera, en teoría, alterar o incapacitar sus herramientas de IA si eran usadas con fines militares en tiempos de guerra, una acusación que ahora la compañía rechaza de plano con argumentos técnicos.

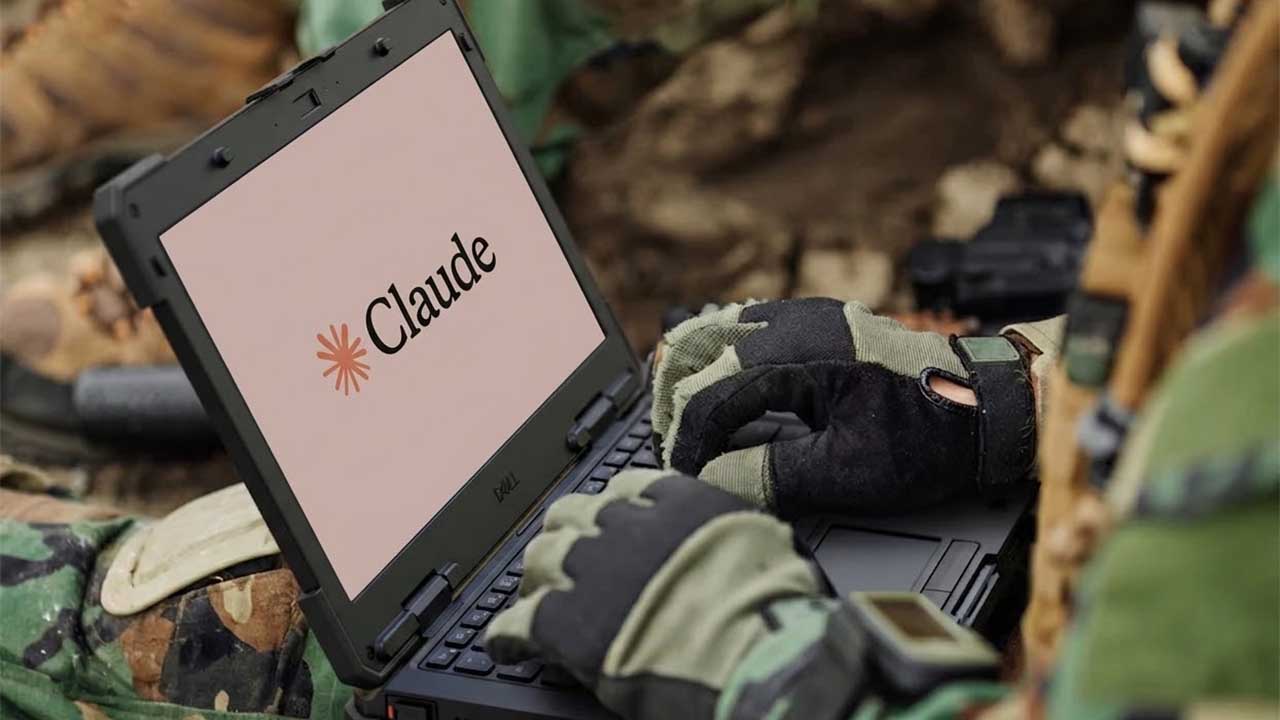

El modelo Claude es uno de los sistemas de inteligencia artificial generativa más avanzados y compite directamente con productos como GPT de OpenAI. Su posible integración en sistemas de defensa y análisis militar ha puesto bajo escrutinio las salvaguardas y el grado de control final que la empresa mantiene sobre su propia creación.

En un documento judicial presentado como parte del caso, Anthropic ha hecho una serie de afirmaciones clave sobre sus capacidades técnicas y operativas:

Incapacidad para interferir

La empresa declaró que “nunca ha tenido la capacidad” de hacer que Claude deje de funcionar, altere su funcionalidad, corte su acceso o influya de manera perjudicial en operaciones militares una vez que el sistema está en uso.

Esta afirmación constituye el núcleo de su argumento de defensa.

Arquitectura sin control remoto

Según la declaración, la arquitectura y los protocolos de implementación de Claude no están diseñados con un mecanismo de “interruptor de apagado” remoto que Anthropic pueda activar a voluntad, especialmente en entornos aislados o seguros propios del ámbito castrense.

Respuesta a preocupaciones del gobierno

La presentación judicial es una respuesta oficial a lo que fuentes describen como acusaciones o profundas inquietudes por parte del gobierno sobre un posible sabotaje en tiempos de guerra, un escenario que la empresa considera técnicamente imposible de ejecutar por su parte.

Esta declaración legal tiene implicaciones significativas para la creciente relación entre el complejo militar-industrial y la industria de la IA civil.

Al negar cualquier capacidad de “interruptor de apagado”, Anthropic busca generar confianza en que sus herramientas son estables y autónomas una vez desplegadas, eliminando el espectro de que un proveedor civil pueda convertirse en un punto único de fallo o en un actor de riesgo durante un conflicto.

La postura de la empresa establece un precedente sobre cómo las compañías de tecnología pueden responder a las demandas de supervisión y control por parte de los gobiernos. Afirma, en esencia, que la naturaleza misma de su tecnología le impide cumplir con una hipotética orden de sabotaje, incluso si quisiera.

Para el Pentágono y otras agencias, esta clarificación técnica puede ser un arma de doble filo: mientras disipa el miedo a la interferencia maliciosa, también subraya que, una vez entregada, la herramienta opera fuera del control directo de su creador, lo que podría plantear nuevos dilemas sobre responsabilidad y gestión de riesgos.