Una filtración involuntaria del código fuente de Claude Code, la herramienta de ingeniería de software impulsada por IA de Anthropic, ha obligado a la empresa a emitir múltiples avisos de retirada bajo la ley DMCA en GitHub.

La plataforma actuó sobre estas solicitudes, eliminando numerosos repositorios que albergaban el material protegido, en un incidente que la propia startup de inteligencia artificial calificó como accidental.

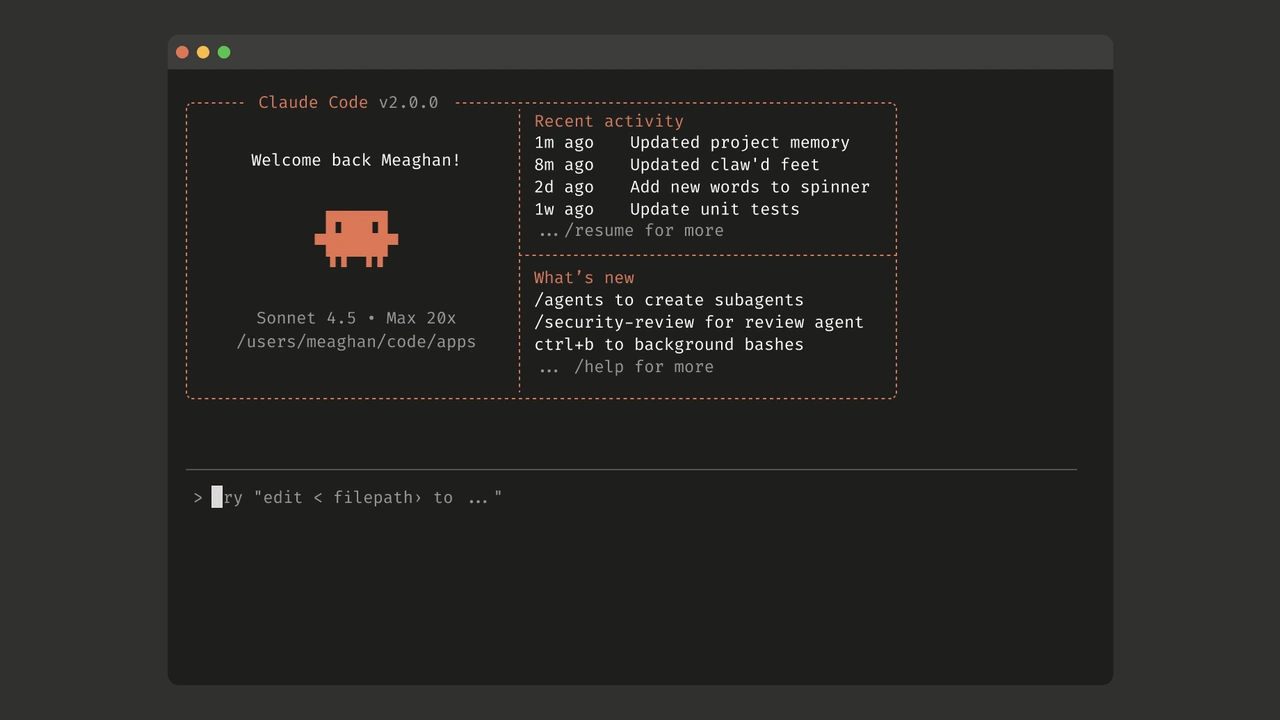

Anthropic, la empresa creadora del modelo de lenguaje Claude, había desarrollado Claude Code como un asistente especializado para tareas de programación. La herramienta forma parte de la creciente competencia en el ámbito de los asistentes de código impulsados por IA, un sector donde la protección de la propiedad intelectual y los modelos de negocio subyacentes son cruciales.

La filtración del código fuente representa un incidente de seguridad significativo para la compañía, exponiendo potencialmente detalles internos de su desarrollo.

El código filtrado comenzó a circular en GitHub, la plataforma de Microsoft para desarrolladores, donde los usuarios suelen compartir y colaborar en proyectos.

Al percatarse de la filtración, Anthropic inició acciones legales para proteger su propiedad intelectual, un movimiento común en la industria tecnológica pero que en este caso presenta matices particulares.

El código fuente de Claude Code fue expuesto de manera no intencionada, según reconoció la propia empresa. Los detalles técnicos sobre cómo ocurrió exactamente la filtración no han sido hechos públicos.

Para contener la dispersión del código, Anthropic presentó solicitudes formales de retirada a GitHub bajo la Ley de Derechos de Autor de la Era Digital (DMCA), la herramienta legal estándar para estos casos.

La plataforma procedió a eliminar los repositorios señalados en las notificaciones de Anthropic. Un reporte de TechCrunch sugiere que el número de repositorios afectados podría ascender a miles, aunque esta cifra específica no ha sido corroborada por otras fuentes primarias.

“La exposición inicial del código fue accidental, y nuestras acciones posteriores buscaron proteger nuestra propiedad intelectual”, explicó un portavoz de Anthropic, según recoge TechCrunch.

El incidente coloca a Anthropic en una posición paradójica. La empresa, que se ha posicionado como defensora de los desarrollos éticos en IA y la protección de la propiedad intelectual, se ve ahora en la obligación de aplicar medidas legales estrictas para salvaguardar su propio código.

La retirada masiva, descrita por Anthropic como un paso necesario aunque derivado de un error inicial, también pone de relieve los mecanismos automatizados y la escala con la que pueden actuar las solicitudes DMCA.

Mientras GitHub generalmente cumple con estas notificaciones para mantenerse a cubierto de responsabilidades legales, la acción puede eliminar no solo copias directas, sino también proyectos derivados que podrían caer en un área gris.