La plataforma de video YouTube ha iniciado una prueba piloto que solicita directamente a una parte de sus espectadores que señalen los contenidos que “parecen basura generada por IA” (AI slop), en un esfuerzo por combatir la proliferación de material de baja calidad creado con herramientas de inteligencia artificial.

Este sistema de retroalimentación humano pretende ser una nueva línea de defensa contra el spam automatizado que inunda la plataforma.

El término “AI slop” se ha popularizado en los últimos años para describir el contenido masivo, repetitivo y de escaso valor, generado total o mayoritariamente por sistemas de inteligencia artificial con el fin de captar vistas y monetización.

La explosión de herramientas de generación de video, audio e imagen ha facilitado que canales produzcan este material a un ritmo imposible para los creadores humanos, saturando los algoritmos de recomendación y degradando la experiencia del usuario.

Frente a este desafío, YouTube explora soluciones más allá de sus sistemas automatizados de moderación. La prueba, confirmada por varios reportes independientes, representa un cambio táctico: convertir a la comunidad en jueces activos de la calidad del contenido.

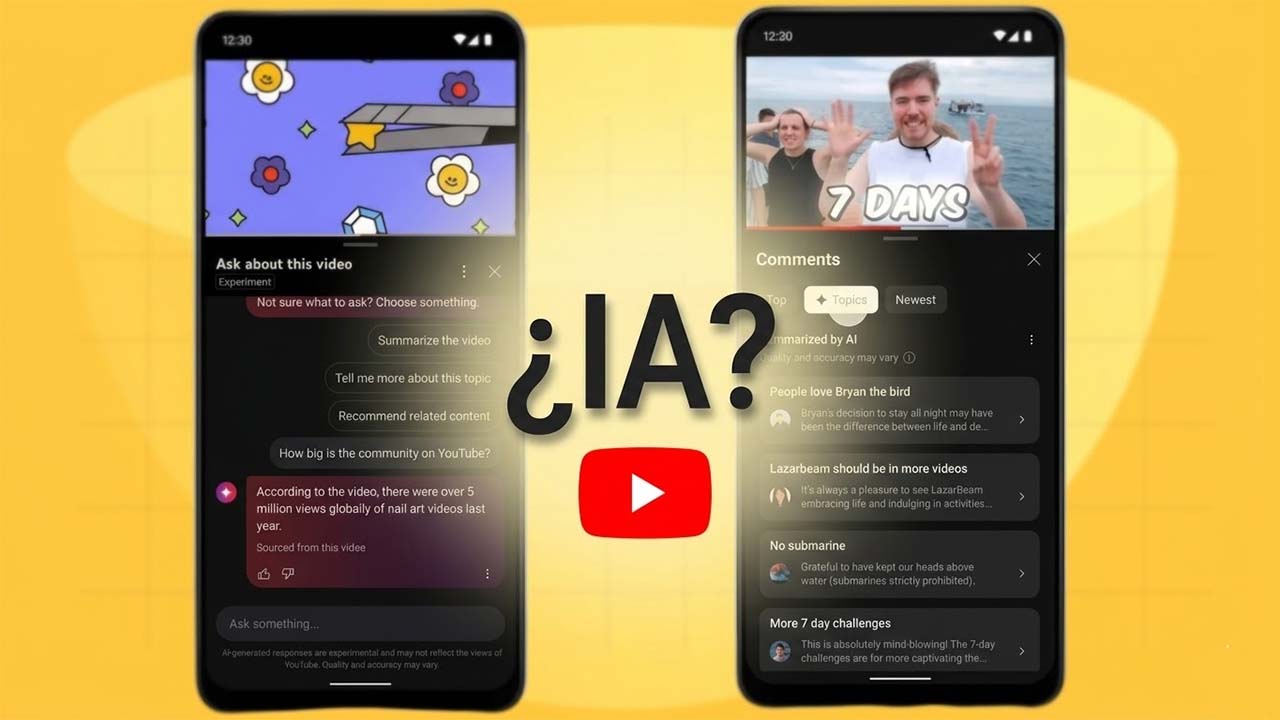

Según usuarios que han participado en la prueba, la plataforma ha desplegado un nuevo mecanismo de retroalimentación. Los cambios clave reportados son:

Algunos espectadores ahora ven una pregunta superpuesta o en la interfaz que indaga si el video que están viendo “parece o se siente como AI slop*”.

El propósito oficial de esta recolección de datos es identificar y marcar contenido de baja calidad generado por IA, presumiblemente para ajustar su visibilidad o priorizarlo para revisión.

La función se está probando con un subconjunto de usuarios, lo que indica que es una etapa experimental cuyos resultados determinarán su implementación global.

La reacción entre la comunidad en línea ha sido mixta. Por un lado, muchos usuarios celebran cualquier iniciativa para limpiar la plataforma de contenido insustancial y engañoso. Por otro, ha surgido un escepticismo significativo sobre el verdadero fin de los datos recogidos.

Un matiz importante, reportado por India Today, introduce una capa de controversia: algunos usuarios y observadores temen que esta retroalimentación no se use únicamente para la moderación de contenido, sino también como datos de entrenamiento gratuitos para mejorar el propio modelo de generación de video de Google, Veo.

Esta perspectiva plantea un dilema ético, donde los espectadores podrían estar trabajando inconscientemente para refinar las mismas herramientas que generan el problema que se les pide identificar.

“Algunos internautas creen que la retroalimentación también podría usarse para entrenar el próximo modelo de IA de video Veo de Google”, señala el reporte.

Esta contradicción refleja la posición compleja de las grandes plataformas tecnológicas, que por un lado deben regular los excesos de la IA generativa y por otro lado invierten fuertemente en su desarrollo.