Una mujer de Tennessee, Angela Lipps, recupera su libertad tras pasar casi seis meses en la cárcel por un caso de fraude bancario en otro estado que nunca cometió, producto de una identificación errónea generada por un sistema de reconocimiento facial con IA.

El fallo tecnológico, que la señaló como sospechosa en Fargo, Dakota del Norte, ha desencadenado una demanda judicial contra el Departamento de Policía de Reno, Nevada, revelando una cadena de fallos procesales.

El uso de inteligencia artificial para identificación policial se ha extendido en los últimos años, prometiendo agilizar investigaciones. Sin embargo, organizaciones de derechos civiles y expertos técnicos han alertado repetidamente sobre sus riesgos inherentes, como los sesgos algorítmicos y las tasas de error más altas en ciertos grupos demográficos.

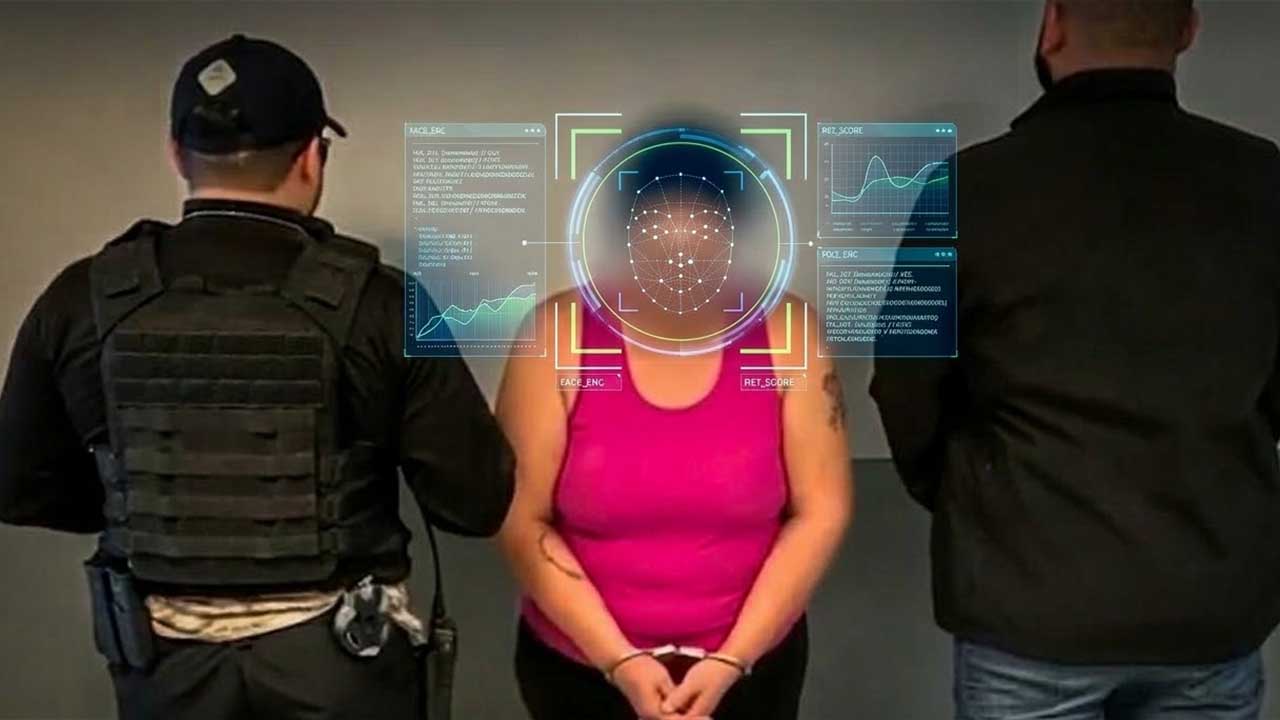

Estos sistemas suelen funcionar como una “pista inicial”, que luego debe ser corroborada minuciosamente por investigadores humanos, un paso que, según el caso reciente, no siempre se sigue.

Los hechos del caso, reportados por múltiples medios, detallan una sucesión de fallos:

Angela Lipps fue detenida mientras cuidaba niños. El motivo fue una orden de arresto vinculada a un caso de fraude bancario en Fargo, Dakota del Norte, un estado donde confirman que nunca había estado.

La policía de Fargo utilizó software de reconocimiento facial que, presuntamente, emparejó la foto de una sospechosa real con la licencia de conducir de Lipps en una base de datos.

A pesar de las evidentes diferencias físicas y la distancia geográfica, Lipps fue extraditada y encarcelada en Dakota del Norte, donde permaneció hasta que la fiscalía desestimó los cargos, seis meses después.

Se ha presentado una demanda civil contra la policía de Reno, donde se procesó la orden, alegando negligencia y violación de derechos civiles.

El impacto personal de este error es devastador: medio año de libertad perdido, separación familiar y un trauma profundo. Más allá del caso individual, el incidente ejemplifica un problema sistémico.

Expertos citados por Tom’s Hardware señalan que, a pesar de casos documentados de identificaciones erróneas que afectan desproporcionadamente a personas de color y mujeres, muchas agencias siguen utilizando esta tecnología sin supervisión suficiente ni protocolos de verificación robustos.

La demanda contra Reno pone el foco en la responsabilidad de las fuerzas del orden. No se trata solo de un algoritmo que falló, sino de un procedimiento policial que aceptó su resultado sin la debida diligencia, ignorando lo que una verificación humana básica habría revelado.

El caso de Angela Lipps no es aislado. Se enmarca en una creciente ola de escrutinio legal y social hacia las herramientas de vigilancia con IA.

Cada incidente de este tipo debilita la confianza pública y alimenta el debate sobre la necesidad de una regulación estricta que establezca límites al uso de la identificación biométrica, auditorías obligatorias para estos sistemas y la prohibición de usarlos como única prueba para una detención.